Fir BMS, BUS, Industrie, Instrumentatiounskabel.

Den Elon Musk an den xAI-Team hunn offiziell déi lescht Versioun vu Grok, Grok3, während engem Livestream lancéiert. Virun dësem Event huet eng bedeitend Quantitéit un Informatiounen, zesumme mam Musk sengem 24/7 Promotiounshype, d'global Erwaardunge fir Grok3 op ongehéiert Niveauen erhéicht. Just virun enger Woch huet de Musk während engem Livestream selbstsécher gesot, wéi hien zu DeepSeek R1 kommentéiert huet: "xAI ass amgaang e bessert KI-Modell ze lancéieren." No den Donnéeën, déi live presentéiert goufen, huet Grok3 all aktuell Mainstream-Modeller a Benchmarks fir Mathematik, Wëssenschaft a Programméierung iwwerschratt, woubäi de Musk souguer behaapt huet, datt Grok3 fir Berechnungsaufgaben am Zesummenhang mat de Marsmissioune vu SpaceX benotzt gëtt, a "Duerchbréch op Nobelpräisniveau bannent dräi Joer" virausgesot huet. Awer dëst sinn de Moment just d'Aussoe vum Musk. Nom Start hunn ech déi lescht Betaversioun vu Grok3 getest an déi klassesch Trickfro fir grouss Modeller gestallt: "Wat ass méi grouss, 9.11 oder 9.9?" Leider konnt de sougenannte schlaueste Grok3 dës Fro ouni Qualifikatiounen oder Markéierungen nach ëmmer net richteg beäntwerten. De Grok3 konnt d'Bedeitung vun der Fro net genee identifizéieren.

Dësen Test huet séier vill Opmierksamkeet vu ville Frënn op sech gezunn, an zoufälleg hunn verschidden ähnlech Tester am Ausland gewisen, datt de Grok3 mat grondleeënden Physik-/Mathematikfroen kämpft, wéi zum Beispill "Wéi eng Kugel fällt als éischt vum schiefen Tuerm vu Pisa?". Dofir gouf hien humorvoll als "e Genie, deen net bereet ass, einfach Froen ze beäntwerten" bezeechent.

Grok3 ass gutt, awer et ass net besser wéi R1 oder o1-Pro.

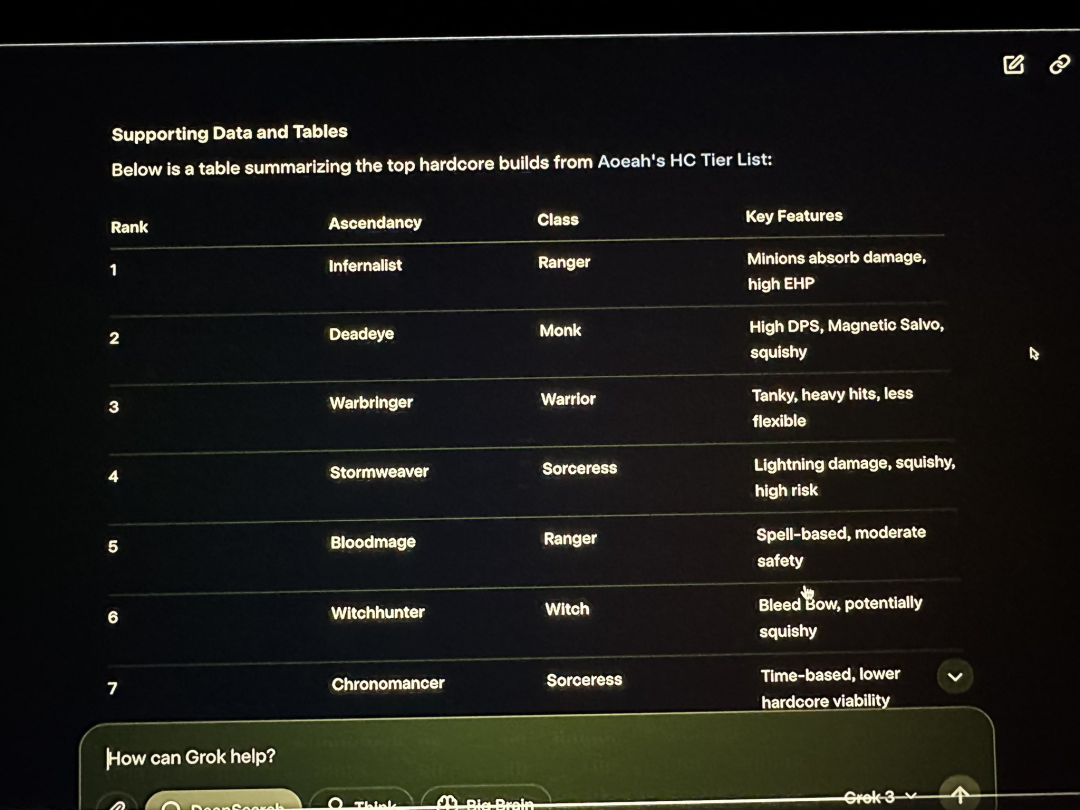

Grok3 huet an der Praxis "Feeler" bei ville gemeinsame Wëssenstester erlieft. Wärend dem xAI-Start-Event huet de Musk demonstréiert, wéi hien Grok3 benotzt fir d'Charakterklassen an d'Effekter vum Spill Path of Exile 2 z'analyséieren, dat hien behaapt huet dacks ze spillen, awer déi meescht vun den Äntwerten, déi Grok3 ginn huet, ware falsch. De Musk huet dëst offensichtlecht Problem wärend dem Livestream net gemierkt.

Dëse Feeler huet net nëmmen weider Beweiser fir auslännesch Netzbürger geliwwert, fir de Musk dofir ze verarschen, datt hien "en Ersatz" am Gaming fonnt huet, mä huet och bedeitend Bedenken iwwer d'Zouverlässegkeet vum Grok3 a prakteschen Uwendungen opgeworf. Fir sou e "Genie", onofhängeg vu senge tatsächleche Fäegkeeten, bleift seng Zouverlässegkeet an extrem komplexen Uwendungsszenarien, wéi Mars-Exploratiounsaufgaben, a Fro.

Aktuell weisen vill Tester, déi viru Wochen Zougang zu Grok3 kruten, an déi, déi d'Modellfäegkeeten gëschter e puer Stonnen getest hunn, all op eng gemeinsam Conclusioun: "Grok3 ass gutt, awer et ass net besser wéi R1 oder o1-Pro."

Eng kritesch Perspektiv op "Disrupting Nvidia"

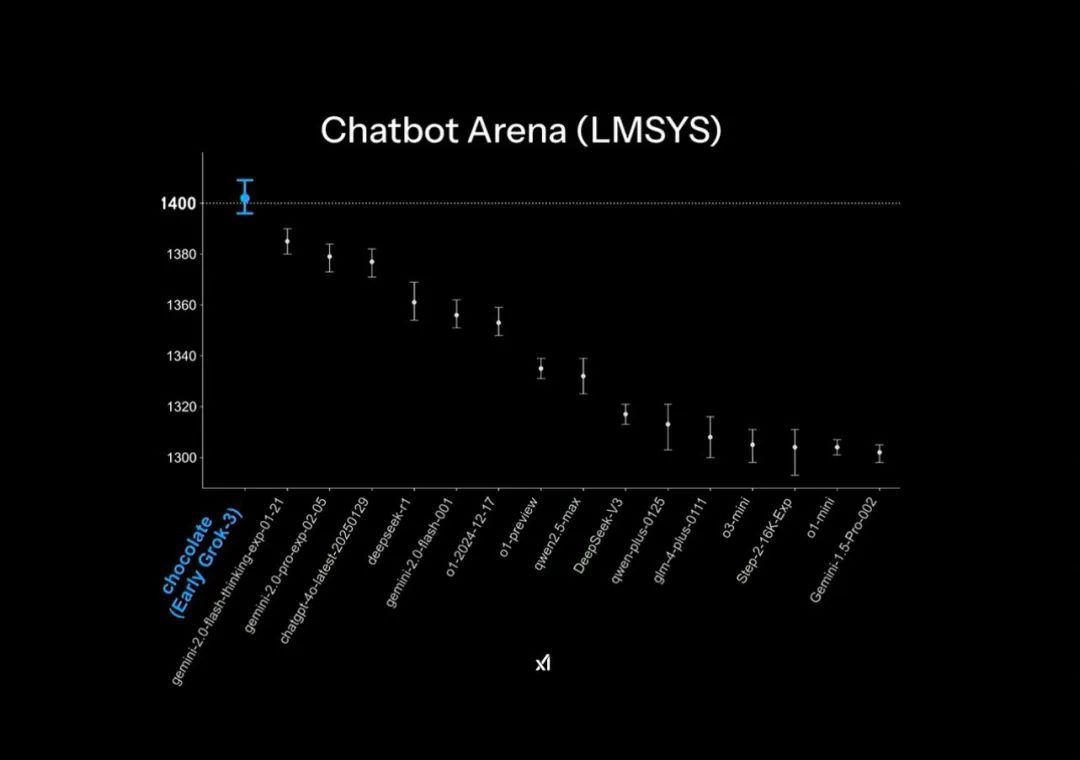

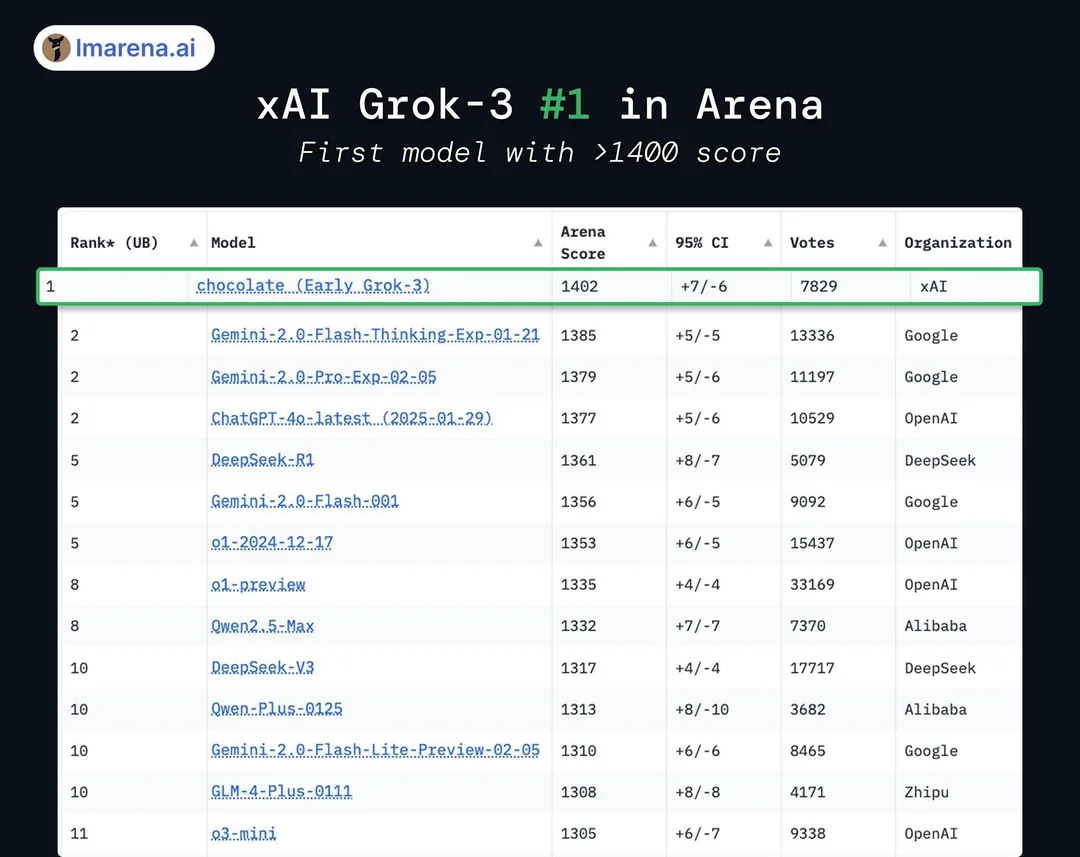

An der offiziell presentéierter PowerPoint-Presentatioun wärend der Verëffentlechung gouf gewisen, datt Grok3 an der Chatbot-Arena "wäit viraus" war, awer dëst huet clever grafesch Technike benotzt: déi vertikal Achs um Leaderboard huet nëmme Resultater am Scoreberäich vun 1400-1300 opgezielt, wouduerch den ursprénglechen Ënnerscheed vun 1% an den Testergebnisse an dëser Presentatioun aussergewéinlech bedeitend ausgesäit.

An de tatsächleche Modellbewertungsresultater läit Grok3 just 1-2% virum DeepSeek R1 an GPT-4.0, wat de Erfahrungen vu ville Benotzer a prakteschen Tester entsprécht, déi "keen merkbare Ënnerscheed" festgestallt hunn. Grok3 iwwertrëfft seng Nofolger nëmmen ëm 1%-2%.

Och wann Grok3 méi héich Punkte wéi all aktuell ëffentlech geteste Modeller huet, huelen vill dat net eescht: schliisslech gouf xAI schonn an der Grok2-Ära fir "Punktmanipulatioun" kritiséiert. Well d'Leaderboard de Stil vun der Äntwertlängt bestrooft huet, sinn d'Punkten däitlech erofgaang, soudatt Brancheninsider dacks de Phänomen "héich Punktzuelen awer niddreg Fäegkeeten" kritiséiert hunn.

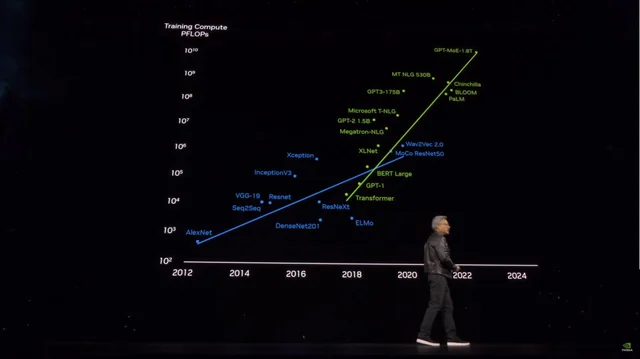

Egal ob duerch "Manipulatioun" vun de Leaderboards oder Designtricks an Illustratiounen, si weisen xAI an dem Musk seng Obsessioun mat der Iddi, "de Pack ze féieren" a punkto Modellfäegkeeten. De Musk huet e groussen Präis fir dës Margen bezuelt: wärend dem Start huet hie sech domat gebrëscht, 200.000 H100 GPUs ze benotzen (a während dem Livestream "iwwer 100.000" behaapt) an eng Gesamttrainingszäit vun 200 Millioune Stonnen erreecht ze hunn. Dëst huet e puer dozou bruecht ze gleewen, datt et en anere bedeitende Virdeel fir d'GPU-Industrie duerstellt an den Impakt vun DeepSeek op de Secteur als "domm" ze betruechten. Besonnesch gleewen e puer, datt reng Rechenleistung d'Zukunft vum Modelltraining wäert sinn.

Wéi och ëmmer, hunn e puer Netzbürger de Verbrauch vun 2000 H800 GPUs iwwer zwee Méint verglach fir den DeepSeek V3 ze produzéieren, a berechent datt de tatsächleche Trainingsstroumverbrauch vum Grok3 263 Mol méi héich ass wéi dee vum V3. Den Ënnerscheed tëscht dem DeepSeek V3, deen 1402 Punkte krut, an dem Grok3 ass knapp ënner 100 Punkten. Nom Verëffentleche vun dësen Donnéeën hunn vill séier gemierkt, datt hannert dem Titel vum Grok3 als "stäerksten op der Welt" en kloeren marginalen Utility-Effekt verstoppt - d'Logik, datt méi grouss Modeller eng méi staark Leeschtung generéieren, huet ugefaang ofhuelend Rendementer ze weisen.

Och mat "héijer Bewäertung awer gerénger Fäegkeet" hat Grok2 grouss Quantitéiten un héichqualitativen First-Party-Daten vun der X (Twitter) Plattform fir d'Benotzung z'ënnerstëtzen. Wéi och ëmmer, beim Training vu Grok3 ass xAI natierlech op déi "Plafong" gestouss, mat där OpenAI aktuell konfrontéiert ass - de Manktem u Premium-Trainingsdaten weist séier den marginalen Notzen vun de Fäegkeete vum Modell op.

D'Entwéckler vu Grok3 a Musk sinn wahrscheinlech déi Éischt, déi dës Fakten grëndlech verstoen an identifizéieren, dofir huet de Musk ëmmer erëm op de soziale Medien erwähnt, datt d'Versioun, déi d'Benotzer elo erliewen, "nach just d'Beta" ass an datt "déi komplett Versioun an de kommende Méint erauskënnt". De Musk huet d'Roll vum Produktmanager vu Grok3 iwwerholl a proposéiert, datt d'Benotzer Feedback zu verschiddene Problemer an der Kommentarsektioun ginn. Hie kéint dee Produktmanager mat de meeschte Follower op der Welt sinn.

Awer bannent engem Dag huet d'Performance vum Grok3 onzweifelhaft Alarm ausgeléist fir déi, déi gehofft hunn, sech op "massiv Rechenkraaft" ze verloossen, fir méi staark grouss Modeller ze trainéieren: baséiert op ëffentlech verfügbare Microsoft-Informatiounen huet den OpenAI GPT-4 eng Parametergréisst vun 1,8 Billiounen Parameteren, méi wéi zéngmol sou vill wéi de GPT-3. Rumeuren suggeréieren, datt d'Parametergréisst vum GPT-4.5 nach méi grouss kéint sinn.

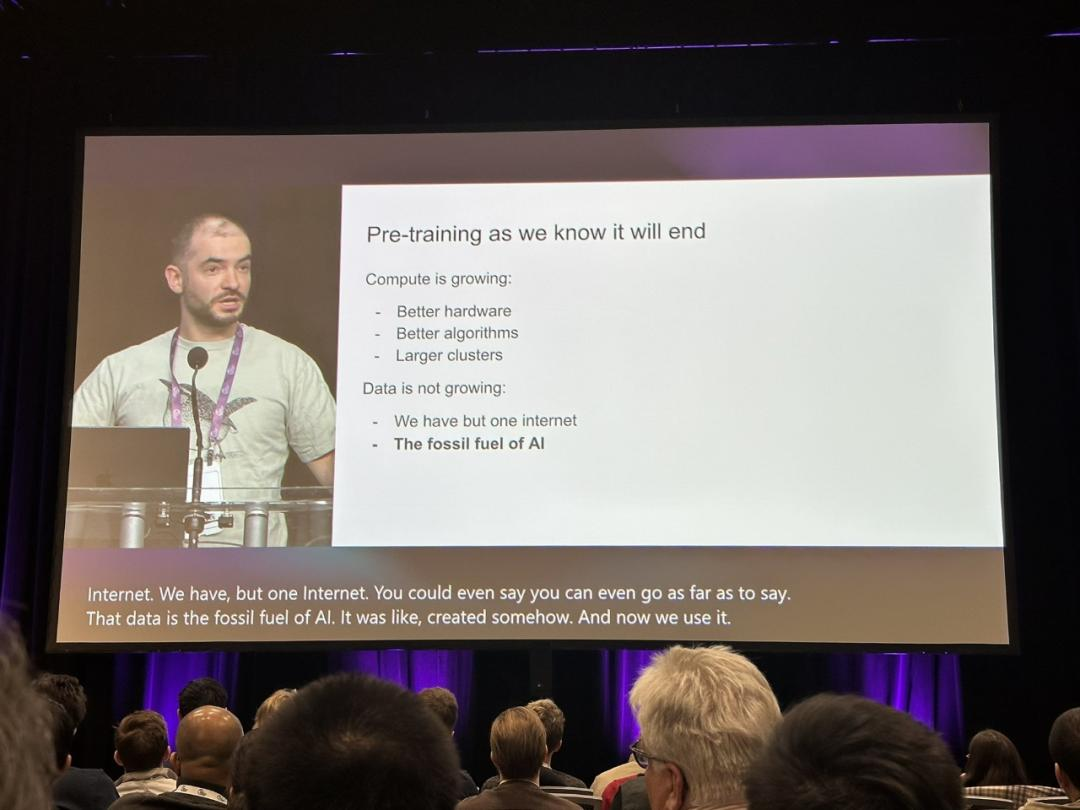

Well d'Modellparametergréissten an d'Luucht goen, steigen och d'Trainingskäschten an d'Luucht. Mat der Präsenz vu Grok3 mussen Konkurrenten wéi GPT-4.5 an anerer, déi weider "Suen verbrenne" wëllen, fir eng besser Modellleistung duerch Parametergréisst z'erreechen, d'Limit berücksichtegen, déi elo kloer a Siicht ass, a sech Gedanken doriwwer maachen, wéi se se iwwerwannen kënnen. An dësem Moment hat den Ilya Sutskever, fréiere Chefwëssenschaftler bei OpenAI, am leschte Dezember gesot: "D'Virausbildung, mat där mir vertraut sinn, wäert op en Enn goen", wat an den Diskussiounen erëm opgedaucht ass, an d'Efforte fir de richtege Wee fir d'Training vu grousse Modeller ausgeléist huet.

Dem Ilya säi Standpunkt huet Alarm an der Industrie geschloen. Hie huet déi bevirstehend Erschöpfung vun zougänglechen neien Daten präzis virausgesot, wat zu enger Situatioun féiere kéint, an där d'Performance net weider duerch Datenerfassung verbessert ka ginn, a vergläicht dat mat der Erschöpfung vu fossile Brennstoffer. Hie sot, datt "wéi Ueleg, vum Mënsch generéierten Inhalt am Internet eng limitéiert Ressource ass". An de Prognosen vum Sutskever wäert déi nächst Generatioun vu Modeller, no der Pre-Training, "richteg Autonomie" a Fäegkeeten zum Denken hunn, "ähnlech wéi dat mënschlecht Gehir".

Am Géigesaz zu den haitege virtrainéierte Modeller, déi haaptsächlech op Inhaltsugläichung baséieren (baséiert op dem virdru geléierte Modellinhalt), wäerten zukünfteg KI-Systemer fäeg sinn, Methodologien ze léieren an z'etabléieren, fir Problemer op eng Manéier ze léisen, déi dem "Denken" vum mënschleche Gehir ähnlech ass. E Mënsch kann fundamental Kompetenz an engem Fach nëmme mat Basisprofessioneller Literatur erreechen, während e grousst KI-Modell Millioune Datenpunkte brauch, fir nëmmen déi elementarst Effizienz op Ufängerniveau z'erreechen. Och wann d'Formuléierung liicht geännert gëtt, kënnen dës fundamental Froen net richteg verstanen ginn, wat illustréiert, datt de Modell sech net wierklech an der Intelligenz verbessert huet: déi fundamental, awer onléisbar Froen, déi um Ufank vum Artikel ernimmt goufen, stellen e kloert Beispill fir dëst Phänomen duer.

Conclusioun

Wann et awer iwwer brutal Gewalt erausgeet, géif Grok3 et tatsächlech fäerdeg bréngen, der Industrie ze weisen, datt "virtrainéiert Modeller hirem Enn ukënnegen", dat bedeitend Auswierkunge fir de Beräich hunn.

Vläicht nodeems d'Wahnsinn ronderëm Grok3 lues a lues ofhëlt, wäerte mir méi Fäll wéi dem Fei-Fei Li säi Beispill gesinn, wou hien "High-Performance-Modeller op engem spezifeschen Datesaz fir nëmmen 50 Dollar ofstëmmt" a schliisslech de richtege Wee zu AGI entdeckt.

Kontrollkabelen

Strukturéiert Kabelsystem

Netzwierk & Daten, Glasfaserkabel, Patchkabel, Moduler, Frontplack

16.-18. Abrëll 2024 Energie am Mëttleren Osten zu Dubai

16.-18. Abrëll 2024 Securika zu Moskau

9. Mee 2024 LANCIERUNGSVERanstaltung fir nei Produkter & Technologien zu Shanghai

22.-25. Oktober 2024 SECURITY CHINA zu Peking

19.-20. November 2024 CONNECTED WORLD KSA

Zäitpunkt vun der Verëffentlechung: 19. Februar 2025